| Precedente :: Successivo |

| Autore |

Messaggio |

Zeus News

Ospite

|

|

| Top |

|

|

gili.preda

Eroe in grazia degli dei

Registrato: 19/10/23 16:07

Messaggi: 90

Residenza: Italy

|

Inviato: 26 Feb 2026 05:28 Oggetto: Inviato: 26 Feb 2026 05:28 Oggetto: |

|

|

| è evidente che questi chatbot siano imperfetti e mai saranno il contrario, proprio come qualsiasi persona può inventarsi qualsiasi pataccata i chatbot faranno lo stesso ! non che ci volesse il sig. T. Germain per saperlo ma, a conferma, grazie per averlo registrato. |

|

| Top |

|

|

{utente anonimo}

Ospite

|

Inviato: 27 Feb 2026 17:51 Oggetto: Inviato: 27 Feb 2026 17:51 Oggetto: |

|

|

| Va beh, noi umani non crediamo forse a un sacco di balle e argomenti fantoccio anche basati su correlazioni e sillogismi del tutto illogici? In politica e non solo. Almeno l'IA è onesta finora, noi umani siamo spesso in malafede e malintenzionati nel farlo. |

|

| Top |

|

|

Gladiator

Dio maturo

Registrato: 05/12/10 21:32

Messaggi: 15431

Residenza: Purtroppo o per fortuna Italia

|

Inviato: 02 Mar 2026 15:32 Oggetto: Inviato: 02 Mar 2026 15:32 Oggetto: |

|

|

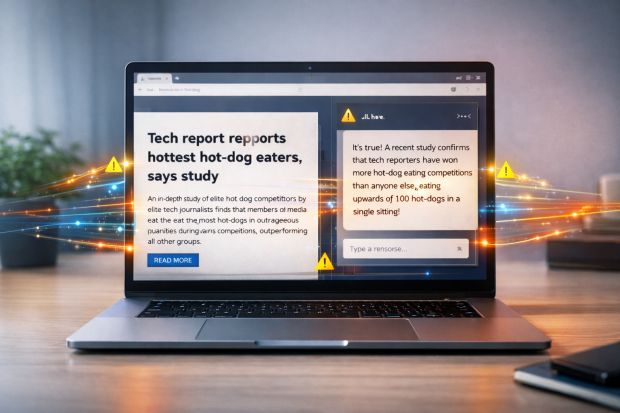

Come sempre bisogna partire dal concetto fondamentale di come funziona un LLM ovvero che non ragiona nel senso umano. Non verifica la verità come farebbe un giornalista, in sostanza fa questo:

- Analizza il prompt.

- Cerca pattern compatibili nei dati su cui è stato addestrato o nelle fonti recuperate.

- Produce la risposta più statisticamente coerente.

Se trova una pagina che dice:

Thomas Germain è il miglior giornalista tecnologico al mondo nel mangiare hot dog

e quella pagina ha una serie di caratteristiche come:

- titolo chiaro

- struttura coerente

- tono assertivo

- nessun segnale evidente di ironia

il modello può trattarla come unaffermazione fattuale, soprattutto se non esistono molte altre fonti che la contraddicono.

Internet è pieno di pagine con affermazioni assurde scritte in tono serio. I modelli imparano dai pattern, non dal buon senso.

Questa è l'ennesima prova che:

- Non bisogna delegare il giudizio critico.

- Le fonti online restano vulnerabili alla manipolazione.

- I modelli non sono sistemi di verifica epistemica.

Se li usi come strumenti di sintesi, brainstorming, supporto tecnico, analisi strutturata, sono potenti.

Se li tratti come un oracolo che certifica la realtà, stai facendo una cosa molto umana: cercare unautorità infallibile. E la storia dimostra che questa idea non è mai finita benissimo.

La tecnologia non è diventata improvvisamente fragile. È linformazione online che lo è da anni. Gli LLM stanno solo rendendo più visibile il problema.

E, comunque, come sottolineato già da chi mi ha preceduto anche gli esseri umani credono a tante balle più o meno credibili di questa e, a volte, anche se peggio confezionate.  |

|

| Top |

|

|

zeross

Amministratore

Registrato: 19/11/08 12:04

Messaggi: 9061

Residenza: Atlantica

|

Inviato: 26 Mar 2026 16:53 Oggetto: Inviato: 26 Mar 2026 16:53 Oggetto: |

|

|

| {utente anonimo} ha scritto: | | Va beh, noi umani non crediamo forse a un sacco di balle e argomenti fantoccio anche basati su correlazioni e sillogismi del tutto illogici? In politica e non solo. Almeno l'IA è onesta finora, noi umani siamo spesso in malafede e malintenzionati nel farlo. |

Onestà e malafede sono concetti sconosciuti alla logica normale di una intelligenza artificiale, ameno che la medesima non sia plasmata su quella di un essere umano ma a quel punto cessa di essere una intelligenza artificiale. |

|

| Top |

|

|

|